マンガdeひもとく生命科学のいま ドッキン!いのちの不思議調査隊

第20話 リアルハプティクス

調査のまとめドッキンレポート

調査のまとめドッキンレポート

力触覚を伝えるリアルハプティクス

「ハプティクス」って言葉を初めて聞く人も多いだろう。ギリシャ語の「 ἅπτικός (haptikos):触れる感覚に関するもの」という言葉に由来し、すべすべザラザラといった「触覚」と、さわったり持ったりした際に指や手に感じる硬さや重さなどの「力覚」とをあわせた「力触覚」を伝送する技術として使われるようになった言葉なんだって。

もし手元のコントローラーに遠くのものをさわった感覚がリアルに伝わってくるなら、ロボットを遠隔操作してさまざまな仕事をさせたり、東京の大病院にいながら離島の患者さんの外科手術を行ったりすることもできるはず。

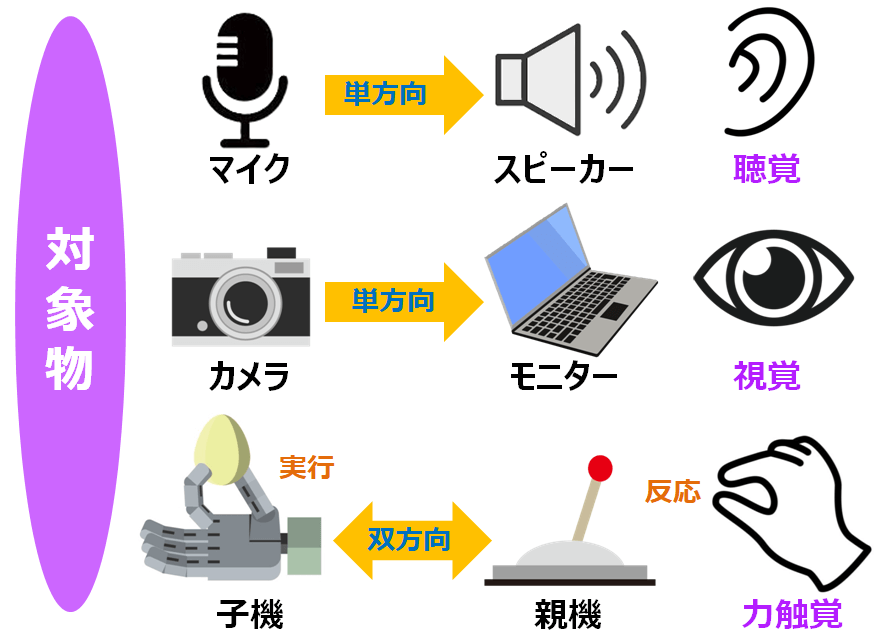

すでに、聴覚の伝送は19世紀に電話として、視覚の伝送は20世紀にテレビとして実現していた。でも、力触覚の伝送は1940年ごろから莫大な資金が投入され盛んに研究されてきたけれど、長らく実現できなかったという。実現不可能ともいわれていた力触覚の伝送に2002年に成功したのが、慶應義塾大学の大西公平先生ドキ。

大西先生が開発した技術は、実物にさわったときと同じ力触覚を伝送するもので、「リアルハプティクス」というのだそうだ。いったいどんな装置を使って、どのように感じられるものなんだろう?

ポテトチップスを掴めるし、スポンジをさわる感覚がリアル!

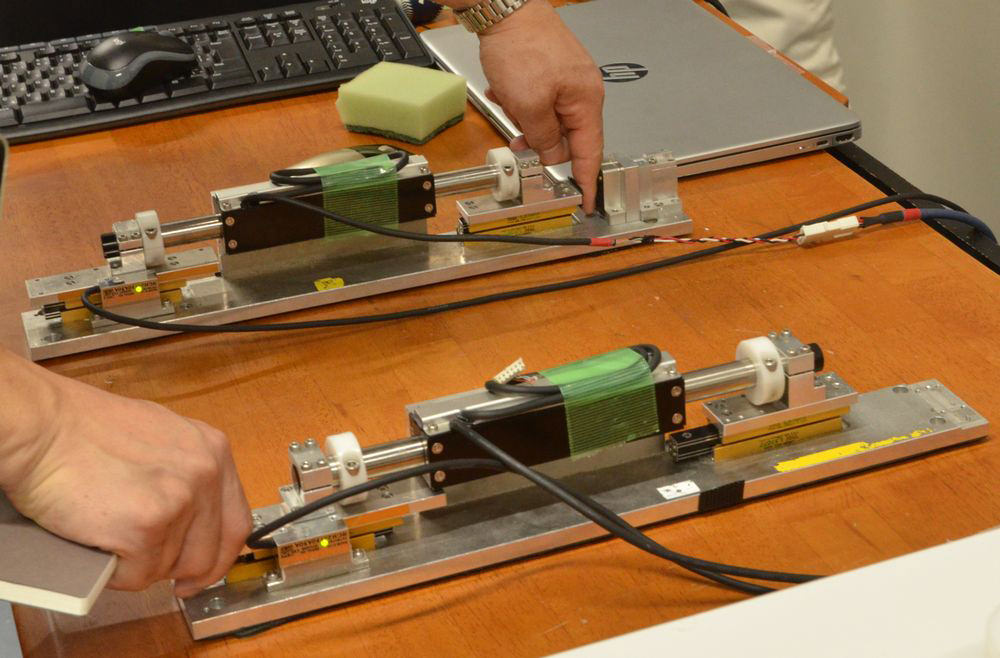

実験室に入ると、長机の上にいろいろなデモ機が置いてあった。どれも予想以上にコンパクトなサイズ。あちこちにカメラがあって、センサがいっぱい取りつけられた大きな装置が必要なのかと思っていたけど、そうじゃないんだね。

スライドして動く細長い機械が2つ置いてある。見た目はソックリ。親機と子機があって、親機を動かすと子機も同じように動く。子機に左手の指を置き、右手で親機を動かして子機側の指をはさむと、なんと動かしている右手のほうに、左手の指を押している感覚が伝わってきた!

手前が親機。右手で親機を操作して、向こうの子機に置いた左手の指をはさむと、右手にどう伝わってくるかを体験した。

子機にスポンジをはさんだ場合は、フニャッとした感覚。マジックテープを子機側のスライダーの先と接触する壁部分とにつけておき、テープ同士がくっついた状態から引っ張ると、親機を操作する手にマジックテープをベリッとはがす感覚がリアルに感じられる。

ここでは親機と子機は30cm程度しか離れていないけれど、子機が何百m、何百km離れた場所にあっても同じ感覚が得られるんだそうだ。

次にポテトチップスをロボットハンドでつかむ実験。右側がコントロールする親機で、左側が子機。先生が実際にやってみせてくれた(動画)。そのあとでトライしてみたよ! 力を入れすぎると、ポテトチップスはバリンと割れてしまう。そーっと操作したらうまくできた。ポテトチップスがつかめるロボットとなら、安心して握手ができそうドキ。

ポテトチップスをつかんで台に乗せる(動画6秒)

同じように、スポンジやサイコロ形の木片、プラスチック模型のイチゴもらくらく運べたよ。

ポテトチップスをつかんだときの触覚や力加減のデータを記録しておけば、親機を操作しなくても子機だけで同じ動作を再現することでポテトチップスを運んでくれるし、スポンジやおもちゃのイチゴ、木片など、素材や重さが多少違っても上手に運べるんだって。リアルハプティクス技術って、すごく柔軟に対応できるものなんだね。

スポンジや木片、イチゴ(プラスチック製)を運ぶ(動画27秒)

親機を操作せずに、記録したデータを使って、ポテトチップスを台から運び、また戻した(動画14秒)

とにかく伝わってくる感触が想像以上にリアル! 別のデモ機では、子機側にブロアー(送風機)で空気を吹き付けると、親機をさわっているだけなのに空気が当たっているのが感じられたのには本当にビックリ。クルマのハンドルと、砂利の上に置かれた小さなタイヤが同期した装置では、まるで砂利道を運転しているみたいだった。親機から子機への力信号の伝達率を100倍に増幅すると、そっとさわっただけなのに、らくらく釘が打ち込めるデモ機もあったよ。おもしろい~!

ハンドルを動かすと、砂利道をドライブしている感覚がリアルに伝わってきた。

コロンブスの卵でリアルハプティクス技術確立に成功

先生がリアルハプティクスの開発に本格的に取り組み始めたのは2002年のことドキ。

2000年頃に発売になった米国のインテュイティブ・サージカル社のda Vinci(ダヴィンチ)という手術ロボットを、翌年にアジアで初めて慶應義塾大学が導入した。最先端のロボットを試してみようと外科手術のテストをしていたら、力触覚が備わっていなかったため実験動物に大きな損傷が出てしまったんだって。映像を見て操作するわけだけど、さわった感覚が医師に伝わってこないと安全性が下がってしまうよね。安全な手術ロボットがほしいと考えた医学部長から、「鉗子(かんし:はさみのような形をした手術用の医療器具)に力触覚をつけてほしい」という依頼が大西先生にあったんだって。

加速度制御をはじめ、工作機械やロボットを制御するうえで重要なモーションコントロールについて長年研究していた大西先生は、力触覚の研究も手がけた経験があった。しかし、多くの研究者が取り組んできたものの力触覚はいまだ実現できていなかった。

視覚や聴覚の伝送は、AからBへという単方向のものだけれど、力触覚の場合は、さわったものを押す力(AからB)に加えて、さわったものから押し返してくる力(BからA)を感じるという双方向のやりとりが必要で、しかも、さわったものからの反応が5分後にわかるのでは遅すぎで、さわったと同時に感じる必要がある。

つまり、「双方向性」と「同時性」とをともに満たしながら、遠方とやりとりすることができなくちゃならないんだ。

聴覚・視覚・力触覚の違い

式で示すと‥‥。

fs+fm=0(作用反作用の法則)

vs−vm=0(同期則)

両方の式を満たすには親機も子機も加速度がゼロ、つまり動いてはダメってわけで、力触覚の厳密な伝送は物理理論的には不可能なんだって。

そこで大西先生が思いついたのが、同期則を1000分の数秒というほんのわずかな差だけ時間を遅らせて実現させること。それくらいの時間の差だったら人間は実感することができず、しかも同時性に影響が出ない。まさにコロンブスの卵だったというわけ!!

(正確にいうと、このほかに「アダマール変換」という、時空を別の空間にずらす座標変換のプロセスが必要なんだそうだ。アダマール変換は先生の博士論文の研究で、難しくてとうてい理解できそうにないからここではパス。とにかく、誰もが思いつかなかった工夫をすることで難題を解決したんだ)。

その後、4-5年かけてリアルハプティクス技術をより洗練させた。近年はさらに、位置の情報からそこで発生する力の大きさを推定する親指の爪ぐらいの小さなICチップも完成。これをモーター部分に取りつけるだけで、力触覚を検出するセンサを簡単に実装することができるようになったんだそうだ。

医療、建設、土木、農業etc.応用先はいろいろ

2014年には慶應義塾大学にハプティクス研究センターが開設され、大西先生たちはさまざまな企業と共同でリアルハプティクス技術の応用に取り組んできた。

医療分野では、リアルハプティクス技術確立のきっかけとなったロボット手術用鉗子はもとより、いろいろな器具に力触覚を持たせる研究が進んでいる。医療現場では顕微鏡を見ながら髪の毛より細い針を使って毛細血管をつなぎあわせるなど、繊細な手の感覚が必要となる場面が多い。でもこうした細い針や糸は、いま一つ使用感がない。でもリアルハプティクスの技術を使って力触覚を増幅させると、細かい操作でもより敏感に感触が手に伝わってくるので、まるで太い血管を縫っているような感覚が得られるんだって。

そして、23年3月に発表したのが脊椎手術用のドリルだ。脊椎の周囲には脊髄神経が張り巡らされており、下手をすると神経を傷つけて下半身まひになるリスクがある。そこでリアルハプティクスでドリルが骨を貫通した瞬間の手応えを感じ取って自動停止する機能を持たせて動物実験したところ、手動で操作する骨ドリルの10分の1以下の距離で停止したんだって。これを使えば、経験の浅い医師でも失敗することはなさそうだ。

建築分野では、現場の映像を見ながら、モルタルの硬さや重さをコテで感じつつ左官作業ができるといった例や、危険なトンネル工事の火薬装填を遠隔操作によって安全に実現したなどの事例がある。

農業分野では、腐りかけたミカンを選び出して取り除くロボットハンドシステムの開発に成功。さらに、イチゴやモモ、トマトなどの選果・選別から箱詰めまでを自動化・省人化するシステムを開発中なんだとか。

このほか災害現場で活躍するロボットや、介護や看護などでの応用など、いろいろな分野で共同開発が進んでいるそうだ。

大林組との共同研究で遠隔での左官作業における性能や作業性を実証(2021年3月リリース)

熟練職人や医師の技術の再現も!

大西先生たちのリアルハプティクスの技術がすごいのは、力触覚を遠隔で伝えることができるということだけじゃない。音や映像が録音・録画できるのと同様に、力触覚も記録して再現できるというところドキ。

「動作なら、映像でモーションキャプチャして記録できるじゃないかと思うかもしれませんが、力加減まではわかりません。モーションキャプチャで得られたデータをロボットに入れるだけでは、周囲のものを片っ端からなぎ倒してしまいます。対象物にさわったときの感触や力加減のデータが必須なのです」(大西先生)

記録するのはどのようなデータなんだろうか?

「私たちの皮膚の下には、圧力や振動、皮膚の伸びといった触覚刺激を感知する4種類の感覚受容体があります。色が赤50+緑40+青20などRGBで指定できるのと同様、ぬるぬるとかザラザラといったさまざまな質感も、この4つのパラメータに分解して、1ミリ秒単位で数値化できます。それと、1秒間に5000分割して記録した位置情報とを組み合わせるのです」(大西先生)

記録できるとどんなメリットがあるかというと、まず記録したデータ通りにロボットが同じ作業を再現できる。また、下手な人と、熟練者、その中間とそれぞれのデータをAIに学習させることで、ロボットが熟練者のスキルを身につけることができる。つまりロボットが進化するというのだ。

大西先生は言う。

「日本は超高齢社会に突入し、人手不足が今後さらに深刻化していくでしょう。今のロボットは、ロジカルにプログラムされた定型作業しかできません。これから求められるのは、単純で繰り返しが多いけれど、人間しかこなせない非定型作業を肩代わりしてくれるロボットです。それができないのは、非定型作業には無意識の動作が非常に多いからです」

例えば目の前のペットボトルを掴むとき、ペットボトルがそこにあって、中に水が入っているから手を伸ばそうと思うのは大脳の働きだけど、掴んだ瞬間の力については大脳がコントロールしているのではなく、無意識のもので、こうした動作を担っているのは小脳のメモリなのだという。

「映像とリアルハプティクス技術を使って、人間の無意識な動作やものに合わせた力加減を数値化して記録し、集めたデータを学習させていくことで、ロボットが人間の作業を代替できるようになるんです。個々のロボットがそのデータを持っている必要はありません。データはネットワーク上のクラウドに集積しておいて、必要なときにダウンロードして、ロボットに実行させればいい。つまり、汎用の仕事をこなせるロボットが誕生するわけです。言ってみれば、クラウドにあるのは巨大な小脳。Google社やマイクロソフト社が集めているのはテキストや画像データですが、人間の動作を集めた力触覚のデータは未だありません。日本が勝負できるのは、まさにこの分野なのです」

IoT(Internet of Things:モノのインターネット化)ではなく、IoA(Internet of Actions:行為のインターネット化)ができて初めて、非定型作業や熟練作業をこなす自立した次世代ロボットが誕生するはずだと大西先生は力説する。

いずれは、繊細さと力が必要な介護をサポートしてくれる介護ロボットも誕生するだろう。

また熟練した医師のデータを活用して、難手術のトレーニングをするといった展開も考えられそうだ。

頭足類の目の進化に興味アリ

大西先生は小さい頃から自分でラジオを作ったり実験したりすることが大好きな少年だったそうだ。感電するから危ないといわれてもやってみないと気が済まない。こっそり実験してみて、「やっぱり危ないんだ」と納得するタイプだった。

高校時代にインド哲学・仏教学で高名な中村元(なかむら・はじめ)先生の講演を聞いてインド哲学がおもしろそうだと思ったけれど、鉱山技師だった父に反対され、工学部に進んだ。

大学ではシステム工学をやりたいと、実験と理論の両方が学べる電気工学科に進学。大学院では磁気浮上の台車の運動制御を研究し、その後、外乱(摩擦などの制御システムに対してはたらく妨害となる信号)を推定してフィードバックする手法の開発に成功した。こうして、想定外の入力や外部環境の変化などが生じても安定的に制御する手法や、加速度制御など、モーションコントロール系を中心に探究してきたという。35年前には、現在三重大学電気システム講座の駒田諭(こまだ・さとし)教授と手作りロボットを遠隔操作して缶を掴ませる実験にも取り組んだそうだ。

今後やりたいことは?とうかがうと、「イカやタコなどの頭足類の目の進化について研究したい」と即答。彼らの目は、レンズを通して眼球内に入射した光が網膜上に像を結び、レンズでピント調節する。私たちの目ととてもよく似た構造なのに、イカやタコは皮膚の一部が変化して目になるなど、発生の過程が脊椎動物とまるで違うことが実に興味深いんだって。先生の話を聞いて、ワクワクするドキ!

企業との打ち合わせや実験で現場にも足を運ぶけれど、果実を収穫する際、リンゴは実を持って枝を切るのに、モモは枝を持って実から切り離すことがわかったなんてことを楽しそうに話してくださる。なんにでも好奇心いっぱいで、自分でやってみたいんだって。

そんな先生のみんなへのアドバイスは、「受験勉強のやりすぎで疲れてしまってはダメ。自分がおもしろいと思うことにとことん取り組んでいろいろ想像してほしい」ということだったよ!

リアルハプティクスに興味のある人にオススメ

大西先生に、リアルハプティクスについて詳しく知るための本を教えてもらったドキ。

大西公平/著

『「リアル」を掴む! 力を感じ、感触を伝えるハプティクスが人を幸せにする』

(東京電機大学出版局 2017年2月刊)

高精度な力触覚の伝送に世界で初めて成功した大西先生に、ハプティクスの概要とその原理、センサーが不要な理由、柔らかい自立型ロボットがサポートする未来までを取材。インタビュー形式でまとめた本。

第1章 柔らかく掴む

第2章 遠くから掴む

第3章 汎用機で掴む

第4章 相対性で掴む

第5章 日本発で掴む

生命科学DOKIDOKI研究室の次の記事も読んでみてね!

-

◎医工連携でユニークなロボットを開発しようとする研究を紹介した記事。

■いま注目の最先端研究・技術探検!

第40回 ミミズや生体の動きに着目したロボットで、未来を動かせ!https://www.terumozaidan.or.jp/labo/technology/40/index.html

第3回 めざすは「ミクロの決死圏」 医学と理工学が連携した医療・福祉ロボットの開発

https://www.terumozaidan.or.jp/labo/technology/03/index.html

(取材・文:「生命科学DOKIDOKI研究室」編集 高城佐知子)